Ubuntu 安装 Ollama 完整教程

Ollama 是一个在本地运行大语言模型的工具,支持多种模型,无需复杂的配置。

系统要求

- 操作系统: Ubuntu 20.04 或更高版本

- 内存: 建议 8GB 以上

- 存储空间: 至少 5GB 可用空间

- 网络: 需要访问 GitHub 下载安装包

安装步骤

1. 更新系统

首先更新软件包列表和已安装的软件:

sudo apt update

sudo apt upgrade -y

2. 下载并安装 Ollama

方法一:使用官方安装脚本(推荐)

Ollama 提供了官方的一键安装脚本:

curl -fsSL https://ollama.com/install.sh | sh

这个脚本会自动:

– 下载最新的 Ollama 安装包

– 安装到 /usr/local/bin/ollama

– 创建 systemd 服务

– 配置环境变量

方法二:手动安装

如果脚本安装失败,可以手动安装:

# 下载最新版本(以 0.1.0 为例,请替换为最新版本号)

curl -L https://ollama.com/download/ollama-linux-amd64 -o /tmp/ollama-linux-amd64

# 安装

sudo mv /tmp/ollama-linux-amd64 /usr/local/bin/ollama

sudo chmod +x /usr/local/bin/ollama

# 验证安装

ollama --version

3. 启动 Ollama 服务

安装完成后,Ollama 会自动启动。你可以验证服务状态:

# 检查服务状态

sudo systemctl status ollama

# 如果服务未启动,手动启动

sudo systemctl start ollama

# 设置开机自启

sudo systemctl enable ollama

4. 测试运行

在终端中运行:

# 拉取并运行示例模型

ollama run llama2

# 或运行其他模型

ollama run mistral

ollama run codellama

5. 安装图形界面(可选)

如果你需要图形界面,可以安装 Ollama Desktop:

# 下载 Linux 版本

wget https://ollama.com/download/ollama-linux-amd64.deb

# 安装

sudo dpkg -i ollama-linux-amd64.deb

# 启动

ollama serve

使用方法

命令行使用

# 查看可用模型

ollama list

# 拉取模型

ollama pull llama2

ollama pull mistral

ollama pull codellama

# 运行模型

ollama run llama2

# 与模型交互

# 输入你的问题,按 Ctrl+D 退出

API 调用

Ollama 提供 OpenAI 兼容的 API:

curl http://localhost:11434/api/generate -d '{

"model": "llama2",

"prompt": "你好,请介绍一下自己"

}'

Python 代码调用

from ollama import Client

client = Client(host='http://localhost:11434')

response = client.generate(model='llama2', prompt='你好')

print(response['response'])

JavaScript/TypeScript 调用

import { Ollama } from 'ollama';

const ollama = new Ollama({ host: 'http://localhost:11434' });

const response = await ollama.generate({

model: 'llama2',

prompt: '你好'

});

console.log(response.response);

常用模型列表

Ollama 支持多种开源大语言模型:

| 模型 | 描述 | 大小 | 推荐用途 |

|---|---|---|---|

| llama2 | Meta 开源大模型 | 4.7GB | 通用对话 |

| mistral | Mistral AI 模型 | 4.1GB | 通用对话 |

| codellama | 编程专用 | 4.1GB | 代码生成 |

| wizardlm | WizardLM 模型 | 4.1GB | 通用对话 |

| gemma | Google Gemma 模型 | 2GB | 轻量级对话 |

管理命令

# 查看版本

ollama --version

# 查看已安装模型

ollama list

# 拉取新模型

ollama pull <模型名称>

# 删除模型

ollama rm <模型名称>

# 停止服务

sudo systemctl stop ollama

# 重启服务

sudo systemctl restart ollama

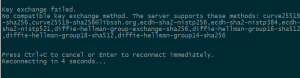

故障排除

问题 1: 权限被拒绝

# 错误信息: permission denied

解决方案:确保使用 sudo 运行,或者将用户添加到 ollama 组:

sudo usermod -aG ollama $USER

newgrp ollama

问题 2: 服务无法启动

# 检查日志

sudo journalctl -u ollama -n 50

问题 3: 内存不足

如果遇到内存不足错误,可以:

– 使用更小的模型(如 gemma)

– 关闭其他占用内存的程序

– 增加系统交换空间

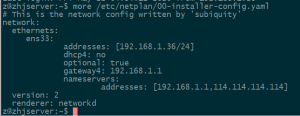

高级配置

环境变量配置

编辑 ~/.bashrc 或 ~/.zshrc:

export OLLAMA_HOST=0.0.0.0:11434

export OLLAMA_MODELS=/path/to/models

然后重新加载配置:

source ~/.bashrc

Systemd 服务配置

如果需要自定义服务配置,编辑 /etc/systemd/system/ollama.service:

[Service]

ExecStart=/usr/local/bin/ollama serve

User=your_username

Group=your_username

Environment="OLLAMA_HOST=0.0.0.0:11434"

Restart=always

重启服务:

sudo systemctl daemon-reload

sudo systemctl restart ollama

性能优化

使用 GPU 加速

确保安装了 NVIDIA 驱动:

nvidia-smi

Ollama 会自动使用 GPU 加速。

调整并发数

编辑 /etc/systemd/system/ollama.service,添加:

Environment="OLLAMA_NUM_PARALLEL=4"

缓存模型

频繁使用的模型可以缓存到内存:

# 预加载模型

ollama pull llama2

安全建议

- 不要在公网暴露 API: 默认只监听

127.0.0.1,不要修改为0.0.0.0 - 使用防火墙: 配置 ufw 限制访问

- 定期更新: 保持 Ollama 和系统更新

# 配置防火墙

sudo ufw allow 22/tcp

sudo ufw allow 11434/tcp # 如果需要远程访问

sudo ufw enable

参考资源

总结

Ollama 是一个强大而易用的本地大语言模型运行工具。通过本教程,你应该已经能够在 Ubuntu 系统上成功安装并使用 Ollama。选择适合你需求的模型,享受本地 AI 的便利吧!

许可证

Ollama 使用 MIT 许可证。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

THE END

暂无评论内容