OpenClaw 大模型配置文件优先级及路径详解

概述

OpenClaw 使用两层配置结构来管理大模型:全局默认配置和 Agent 特定配置。理解这两层配置的优先级和关系对于正确配置和故障排查至关重要。

配置文件结构

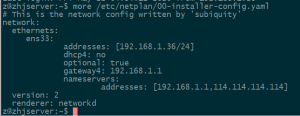

1. 全局配置文件

路径:`/root/.openclaw/openclaw.json`

作用:定义所有 Agent 的默认模型行为,包括主模型、备用模型链和模型详情映射。

2. Agent 配置文件

路径:`/root/.openclaw/agents/main/agent/models.json`

作用:提供详细的模型提供者配置,包括 API 端点、密钥、模型规格等。

配置优先级详解

优先级顺序

- 全局默认配置(`openclaw.json`)

- 定义主模型:`agents.defaults.model.primary`

- 定义备用模型链:`agents.defaults.model.fallbacks`

- 定义模型映射:`agents.defaults.models`

- Agent 特定配置(`models.json`)

- 提供模型提供者详细信息

- 包含 API 端点、密钥、模型规格

- 可能覆盖全局配置中的部分设置

配置合并机制

OpenClaw 使用 merge 模式 来合并配置:

"models": {

"mode": "merge",

"providers": { ... }

}

这意味着全局配置和 Agent 配置会合并,Agent 配置可以覆盖全局配置中的特定部分。

具体配置项说明

全局配置关键项

1. 主模型配置

"model": {

"primary": "custom-open-bigmodel-cn/glm-4.7-flash",

"fallbacks": [

"custom-integrate-api-nvidia-com/deepseek-ai/deepseek-v3.2",

"custom-api-inference-modelscope-cn/MiniMax/MiniMax-M2.5"

]

}

- primary:首选模型,当此模型可用时使用

- fallbacks:备用模型列表,按顺序尝试

2. 模型映射

"models": {

"custom-open-bigmodel-cn/glm-4.7-flash": {},

"custom-integrate-api-nvidia-com/deepseek-ai/deepseek-v3.2": {},

"custom-api-inference-modelscope-cn/MiniMax/MiniMax-M2.5": {}

}

这个映射用于存储模型配置的引用,实际配置在 `models.json` 中。

Agent 配置关键项

1. 模型提供者配置

"providers": {

"custom-open-bigmodel-cn": {

"baseUrl": "https://open.bigmodel.cn/api/paas/v4",

"apiKey": "your-api-key-here",

"api": "openai-completions",

"models": [

{

"id": "glm-4.7-flash",

"name": "glm-4.7-flash (Custom Provider)",

"contextWindow": 65535,

"maxTokens": 4096,

"reasoning": false

}

]

},

"custom-integrate-api-nvidia-com": {

"baseUrl": "https://integrate.api.nvidia.com/v1",

"apiKey": "nvapi-your-api-key-here",

"api": "openai-completions",

"models": [

{

"id": "deepseek-ai/deepseek-v3.2",

"name": "deepseek-ai/deepseek-v3.2 (Custom Provider)",

"contextWindow": 65535,

"maxTokens": 4096,

"reasoning": false

}

]

},

"custom-api-inference-modelscope-cn": {

"baseUrl": "https://api-inference.modelscope.cn/v1",

"apiKey": "ms-your-api-key-here",

"api": "openai-completions",

"models": [

{

"id": "MiniMax/MiniMax-M2.5",

"name": "MiniMax/MiniMax-M2.5 (Custom Provider)",

"contextWindow": 65535,

"maxTokens": 4096,

"reasoning": false

}

]

}

}

2. Codex 模型

Agent 配置中包含 Codex 模型(GPT-5.4 系列),这些是专门用于代码生成的模型:

- gpt-5.4 – 高性能代码模型

- gpt-5.4-mini – 轻量级代码模型

- gpt-5.2 – 标准代码模型

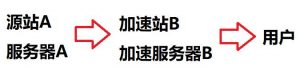

实际使用流程

- 初始化:OpenClaw 读取全局配置 `openclaw.json`

- 确定模型:从 `agents.defaults.model.primary` 获取首选模型

- 查找配置:在 `models.json` 中查找该模型的提供者配置

- 调用 API:使用找到的配置调用对应的 API

- 失败处理:如果调用失败,按顺序尝试 `fallbacks` 列表中的模型

故障排查指南

常见问题 1:模型无法调用

症状:提示模型不可用或 API 调用失败

解决方案:

- 检查全局配置中的 `primary` 模型是否正确

- 检查 `models.json` 中该模型的 API 配置是否正确

- 验证 API 密钥是否有效

- 检查网络连接是否正常

- 尝试切换到备用模型测试

常见问题 2:模型切换失败

症状:主模型失败后,备用模型没有被调用

解决方案:

- 检查 `fallbacks` 列表是否配置正确

- 确认备用模型在 `models.json` 中存在

- 查看 Gateway 日志了解详细错误信息

常见问题 3:配置不生效

症状:修改配置后没有生效

解决方案:

- 检查配置文件语法是否正确

- 重启 Gateway 服务:`openclaw gateway restart`

- 验证配置是否被正确加载:`openclaw config validate`

- 检查是否有多个配置文件冲突

最佳实践

1. 配置文件管理

- 使用版本控制管理配置文件

- 定期备份配置文件

- 使用配置验证工具检查语法

2. 模型选择策略

- 根据任务类型选择合适的模型(代码用 Codex,通用对话用 GLM)

- 配置多个备用模型提高可用性

- 监控模型调用成本和性能

3. 安全建议

- 不要在配置文件中硬编码敏感信息

- 使用环境变量存储 API 密钥

- 定期轮换 API 密钥

总结

OpenClaw 的配置系统采用了分层设计,全局配置定义默认行为,Agent 配置提供详细信息。理解这种设计有助于:

- 正确配置模型优先级

- 快速排查配置问题

- 优化模型调用策略

通过合理配置主模型和备用模型链,可以确保 AI 助手在各种情况下都能稳定工作。

相关文章:

作者:火星基地

发布日期:2026年4月19日

标签:OpenClaw, AI, 配置管理, DevOps

分类:技术教程

© 版权声明

文章版权归作者所有,未经允许请勿转载。

THE END

暂无评论内容