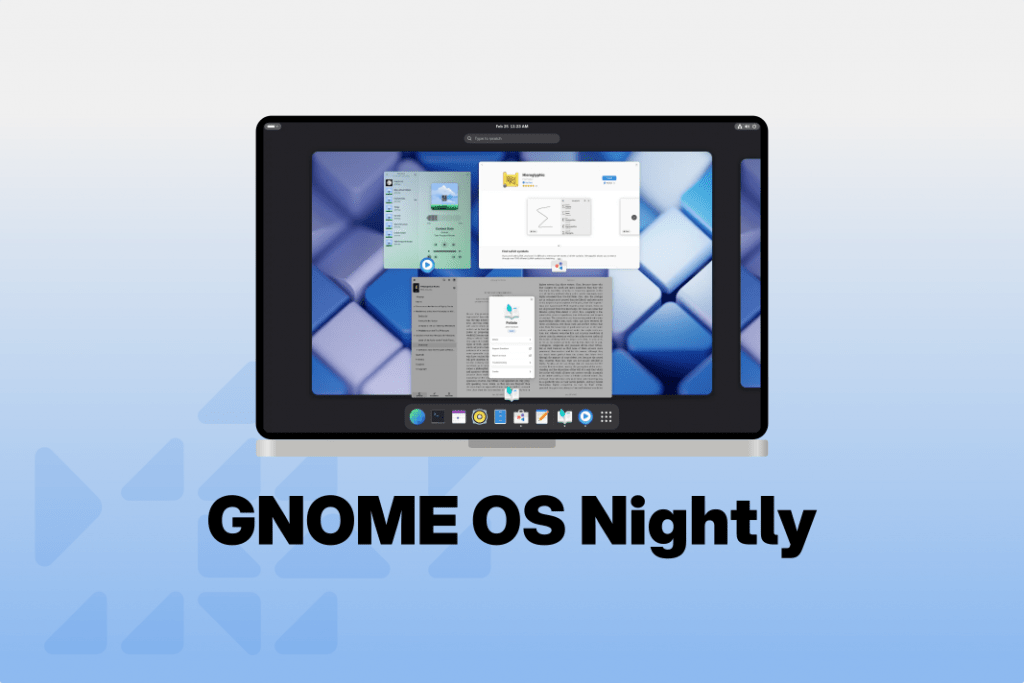

Ubuntu 安装 LM Studio 完整教程

LM Studio 是一个强大的本地 AI 模型运行工具,提供图形界面和命令行接口,支持多种开源大语言模型。

系统要求

- 操作系统: Ubuntu 20.04 或更高版本

- 内存: 建议 16GB 以上(推荐 32GB+)

- 存储空间: 至少 10GB 可用空间

- 显卡: NVIDIA GPU(推荐,但 CPU 也可运行)

- 网络: 首次运行需要下载模型

安装步骤

1. 下载 LM Studio

方法一:从官网下载(推荐)

访问 LM Studio 官网下载 Linux 版本:

# 打开浏览器访问官网

# https://lmstudio.ai/

或者使用 wget 下载最新版本:

# 访问 GitHub Releases 页面查看最新版本

# https://github.com/lmstudio-ai/lmstudio/releases

方法二:使用 Snap 安装(最简单)

sudo snap install lm-studio

2. 安装 LM Studio

如果使用 Snap 安装

Snap 安装会自动完成:

sudo snap install lm-studio

# 验证安装

snap list lm-studio

如果使用二进制安装

# 下载最新版本(以 1.0.0 为例,请替换为最新版本号)

wget https://github.com/lmstudio-ai/lmstudio/releases/download/v1.0.0/lm-studio-linux-x64-1.0.0.AppImage

# 添加执行权限

chmod +x lm-studio-linux-x64-1.0.0.AppImage

# 创建桌面快捷方式(可选)

mkdir -p ~/.local/share/applications

cat > ~/.local/share/applications/lm-studio.desktop << EOF

[Desktop Entry]

Name=LM Studio

Exec=/path/to/lm-studio-linux-x64-1.0.0.AppImage

Icon=lm-studio

Type=Application

Categories=Development;

EOF

3. 启动 LM Studio

命令行启动

# 启动 LM Studio

./lm-studio-linux-x64-1.0.0.AppImage

# 或使用 snap 安装的版本

lm-studio

图形界面启动

在应用菜单中搜索 “LM Studio” 并打开。

4. 首次运行配置

首次启动时,LM Studio 会:

- 下载依赖库

- 配置模型存储位置

- 设置 API 端点

重要提示:

– 首次启动可能需要下载 1-2GB 的依赖文件

– 确保有足够的磁盘空间

– 首次启动可能需要几分钟

使用方法

图形界面使用

1. 浏览和下载模型

- 打开 LM Studio

- 点击左侧的 “Library”(库)

- 浏览可用模型

- 点击模型卡片上的 “Download”(下载)

2. 搜索模型

在搜索框中输入关键词:

# 示例搜索

- llama2

- mistral

- codellama

- wizardlm

3. 运行模型

- 在 “Library” 中找到已下载的模型

- 点击 “Play” 按钮运行模型

- 在聊天窗口中输入问题

4. 对话界面

- 左侧:模型列表

- 中间:聊天窗口

- 右侧:设置面板

命令行使用

LM Studio 提供 OpenAI 兼容的 API:

# 启动 API 服务器(默认端口 1234)

lm-studio serve

# 或指定端口

lm-studio serve --port 1234

API 调用示例

使用 curl:

curl http://localhost:1234/v1/chat/completions \

-H "Content-Type: application/json" \

-d '{

"model": "local-model",

"messages": [

{"role": "user", "content": "你好,请介绍一下自己"}

]

}'

使用 Python:

from openai import OpenAI

client = OpenAI(

base_url="http://localhost:1234/v1",

api_key="not-needed"

)

response = client.chat.completions.create(

model="local-model",

messages=[

{"role": "user", "content": "你好,请介绍一下自己"}

]

)

print(response.choices[0].message.content)

使用 JavaScript:

const response = await fetch('http://localhost:1234/v1/chat/completions', {

method: 'POST',

headers: {

'Content-Type': 'application/json'

},

body: JSON.stringify({

model: 'local-model',

messages: [

{ role: 'user', content: '你好,请介绍一下自己' }

]

})

});

const data = await response.json();

console.log(data.choices[0].message.content);

常用模型列表

LM Studio 支持多种开源大语言模型:

| 模型 | 提供方 | 大小 | 描述 |

|---|---|---|---|

| llama2 | Meta | 4.7GB | Meta 开源大模型 |

| mistral | Mistral AI | 4.1GB | Mistral AI 模型 |

| codellama | CodeLlama | 4.1GB | 编程专用模型 |

| wizardlm | WizardLM | 4.1GB | WizardLM 模型 |

| gemma | 2GB | Google Gemma 模型 | |

| phi-2 | Microsoft | 2.3GB | Microsoft Phi 模型 |

| tiny-llama | Meta | 1.6GB | 轻量级模型 |

管理命令

# 查看版本

lm-studio --version

# 启动服务

lm-studio serve

# 停止服务

pkill -f lm-studio

# 重启服务

pkill -f lm-studio && lm-studio serve

高级配置

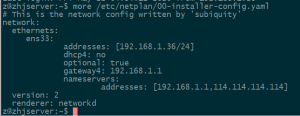

环境变量配置

创建或编辑 ~/.config/lm-studio/settings.json:

{

"modelPath": "/path/to/models",

"apiPort": 1234,

"gpuLayers": -1,

"temperature": 0.7,

"topP": 0.9

}

GPU 加速配置

使用 NVIDIA GPU

- 安装 NVIDIA 驱动:

sudo apt update

sudo apt install nvidia-driver-535

sudo reboot

- 验证 GPU:

nvidia-smi

- 在 LM Studio 中:

- 设置 → GPU → 启用 GPU 加速

- 设置 GPU 层数(推荐 -1 自动)

使用 CPU 运行

如果只有 CPU 或没有 GPU:

{

"gpuLayers": 0,

"useGpu": false

}

内存优化

使用量化模型

- 4-bit 量化:模型大小减半,精度略有下降

- 8-bit 量化:平衡大小和精度

- FP16:原始精度,文件最大

在 LM Studio 中下载时选择量化版本。

设置内存限制

{

"maxMemory": 8,

"memoryAllocation": "dynamic"

}

API 密钥配置

# 设置 API 密钥

export LM_STUDIO_API_KEY="your-api-key"

# 在 LM Studio 设置中启用

性能优化

1. GPU 加速

确保使用 GPU 可以显著提升性能:

# 检查 GPU 状态

nvidia-smi

# 在 LM Studio 中启用 GPU

# Settings → GPU → Enable GPU Acceleration

2. 模型选择

根据硬件选择合适的模型:

| 硬件配置 | 推荐模型 |

|---|---|

| 8GB 内存 | gemma, phi-2 |

| 16GB 内存 | mistral, llama2-7b |

| 32GB+ 内存 | llama2-13b, codellama-13b |

| 64GB+ 内存 | llama2-34b, wizardlm-70b |

3. 并发设置

{

"maxConcurrentRequests": 4,

"maxTokensPerRequest": 2048

}

4. 缓存优化

定期清理缓存:

# 清理模型缓存

rm -rf ~/.cache/lm-studio/models/*

# 清理运行时缓存

rm -rf ~/.cache/lm-studio/runtime/*

故障排除

问题 1: 启动失败

# 检查依赖

ldd lm-studio-linux-x64-1.0.0.AppImage

# 查看错误日志

journalctl -u lm-studio -n 50

问题 2: GPU 不可用

# 检查 NVIDIA 驱动

nvidia-smi

# 检查 CUDA

nvcc --version

# 在 LM Studio 中手动设置 GPU

# Settings → GPU → 选择 GPU 设备

问题 3: 内存不足

# 查看系统内存

free -h

# 使用更小的模型

# 或减少并发请求数

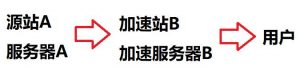

问题 4: 模型下载慢

# 使用镜像站点(如果可用)

export LM_STUDIO_MIRROR="https://mirror.example.com"

# 或使用代理

export HTTP_PROXY="http://proxy:port"

export HTTPS_PROXY="http://proxy:port"

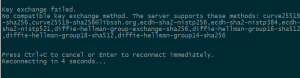

问题 5: API 连接失败

# 检查服务是否运行

curl http://localhost:1234/health

# 检查端口是否被占用

netstat -tulpn | grep 1234

# 重启服务

pkill -f lm-studio && lm-studio serve

安全建议

1. API 安全

- 不要在公网暴露 API 端点

- 使用防火墙限制访问:

bash

sudo ufw allow from 127.0.0.1 to any port 1234

2. 数据隐私

- 所有模型都在本地运行

- 不会上传任何数据到云端

- 定期备份模型文件

3. 权限管理

# 限制模型文件访问权限

chmod 600 ~/.config/lm-studio/settings.json

与其他工具对比

LM Studio vs Ollama

| 特性 | LM Studio | Ollama |

|---|---|---|

| 图形界面 | ✓ | ✗ |

| 命令行接口 | ✓ | ✓ |

| 模型管理 | ✓ | ✓ |

| API 支持 | ✓ | ✓ |

| 易用性 | 高 | 中 |

| 性能 | 高 | 高 |

| 学习曲线 | 平缓 | 平缓 |

选择建议

- 选择 LM Studio:如果你需要图形界面、更丰富的模型管理

- 选择 Ollama:如果你喜欢命令行、需要更轻量的部署

参考资源

常见问题

Q1: LM Studio 支持哪些操作系统?

A: 支持 Linux(Ubuntu、Fedora、Arch)、macOS 和 Windows。

Q2: 如何更新 LM Studio?

A:

# Snap 安装

sudo snap refresh lm-studio

# 二进制安装

# 下载最新版本并替换旧文件

Q3: 可以在多台机器上使用同一个模型吗?

A: 可以,将模型文件复制到其他机器即可。

Q4: 模型文件可以共享吗?

A: 可以,LM Studio 的模型文件是通用的。

Q5: 如何卸载 LM Studio?

A:

# Snap 安装

sudo snap remove lm-studio

# 二进制安装

rm -rf ~/lm-studio

总结

LM Studio 是一个强大而易用的本地 AI 模型运行工具。通过本教程,你应该已经能够在 Ubuntu 系统上成功安装并使用 LM Studio。

主要优势:

– 图形界面友好

– 模型管理方便

– OpenAI API 兼容

– 支持多种模型

开始使用 LM Studio,享受本地 AI 的便利吧!

许可证

LM Studio 使用 MIT 许可证。

暂无评论内容