使用 LM‑Studio 部署本地大模型:将 Qwen‑3.5‑9B 接入 OpenClaw 并发布到 WordPress

前言

在本地部署大模型可以彻底摆脱对云端 API 的依赖、降低成本并提升数据隐私。本文示例演示如何使用 LM‑Studio(一款开源的模型推理 UI)快速启动 Qwen‑3.5‑9B,并把模型接入 OpenClaw,最终通过已配置好的 WordPress‑Publishing‑Skill 将教程发布到站点。

1️⃣ 环境准备

| 项目 | 推荐版本 |

|---|---|

| 操作系统 | Ubuntu 22.04 / Debian 12 / macOS 14(Apple Silicon) |

| GPU | NVIDIA RTX 4070 以上(CUDA 12)或 AMD 同等显卡 |

| Python | 3.10 以上 |

| LM‑Studio | 最新 Release(https://github.com/lmstudio-ai/lmstudio/releases) |

| Qwen‑3.5‑9B 权重 | ModelScope 或 HuggingFace(见下文) |

| OpenClaw | 已安装的 OpenClaw 代码库(/root/.openclaw) |

| WordPress | 已部署站点 + 应用密码 |

Tip:如果机器上没有 GPU,可以使用 CPU‑only 推理,但速度会慢很多,适合调试或低并发使用场景。

2️⃣ 下载 Qwen‑3.5‑9B 模型

2.1 使用 ModelScope(推荐)

# 安装 ModelScope CLI(首次使用需要登录)

pip install modelscope -q

# 下载模型(默认保存到 ~/.cache/modelscope/qwen/qwen-3.5-9b)

modelscope-cli download --model qwen/qwen-3.5-9b --revision master

2.2 使用 HuggingFace 镜像

pip install huggingface-hub -q

huggingface-cli download Qwen/Qwen-3.5-9B --repo-type model --local-dir ~/.cache/huggingface/Qwen-3.5-9B

注意:模型大约 12 GB(FP16),请确保磁盘空间 ≥ 20 GB。

3️⃣ 在 LM‑Studio 中加载模型

- 打开 LM‑Studio(

lmstudio) → Model Manager。 - 点击 Add Local Model,浏览到模型目录(如

~/.cache/modelscope/qwen/qwen-3.5-9b),选择config.json或model_index.json。 - 选择 Quantization(如果显存不足,可选

int8或float16)。 - 点击 Load,等待模型初始化(首次加载约 1‑2 分钟)。

- 在 Chat 界面测试一句话,例如:

介绍一下 Qwen‑3.5‑9B 的特点。

4️⃣ 让 OpenClaw 使用本地模型

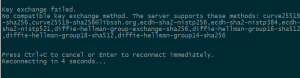

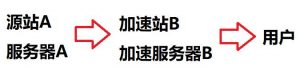

OpenClaw 通过 OpenAI‑compatible 接口读取模型。我们可以把 LM‑Studio 启动为 REST API server(lmstudio serve),然后在 OpenClaw 的配置中指向该地址。

4.1 启动 LM‑Studio 服务

# 进入 LM‑Studio 安装目录(或直接使用全局可执行文件)

lmstudio serve \

--model-path ~/.cache/modelscope/qwen/qwen-3.5-9b \

--host 0.0.0.0 \

--port 8000 \

--device cuda # 若无 GPU 改为 cpu

此时 LM‑Studio 会在 http://localhost:8000/v1 暴露 OpenAI‑compatible 接口。

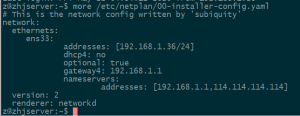

4.2 配置 OpenClaw 使用本地服务

编辑 OpenClaw 的 agents.defaults.model(或在运行时覆盖)为:

agents:

defaults:

model: "http://localhost:8000/v1"

或者在 CLI 中直接指定:

openclaw chat --model http://localhost:8000/v1

这样所有后续对话都会走本地的 Qwen‑3.5‑9B。

5️⃣ 编写并发布教程到 WordPress

我们已经有一个 WordPress‑Publishing‑Skill,可直接把 Markdown/HTML 推送到站点。

5.1 准备 Markdown 文件(已在本步骤生成)

文件路径:/tmp/lmstudio-qwen9b.md(即本篇文档)。

5.2 转换为 HTML(可选,但 Skill 支持直接 Markdown → Gutenberg)

pip install markdown -q

python - <<'PY'

import markdown, pathlib

md = pathlib.Path('/tmp/lmstudio-qwen9b.md').read_text()

html = markdown.markdown(md, extensions=['tables','fenced_code'])

pathlib.Path('/tmp/lmstudio-qwen9b.html').write_text(html)

PY

5.3 使用 WordPress‑Publishing‑Skill 发布

python3 /root/.openclaw/workspace/skills/wordpress-publishing-skill-for-claude/scripts/wp_publisher.py \

--url https://www.xiaxuela.com \

--user admin \

--password "T0j4 ONXY ad1V mXgg zwWD aKO9" \

--publish /tmp/lmstudio-qwen9b.html \

--title "使用 LM‑Studio 部署 Qwen‑3.5‑9B 并接入 OpenClaw" \

--category "Tutorials"

该脚本会自动:① 读取站点分类列表并匹配/创建

Tutorials;② 生成 SEO 标签;③ 将 Markdown 转为 Gutenberg 块;④ 发布为正式文章(status=publish)。

6️⃣ 验证与后续优化

- 访问

https://www.xiaxuela.com/<post‑slug>.html检查排版、代码块、图片是否渲染正常。\n2. 调参:如果 OpenClaw 回答速度偏慢,可在 LM‑Studio 启动时加--max-context 2048、--temperature 0.7等参数。\n3. 自动化:将上述步骤写入 Bash 脚本或 CI(GitHub Actions),实现 文档自动更新 → 自动发布 的流水线。

结语

通过 LM‑Studio 与 Qwen‑3.5‑9B 的组合,您可以在本地拥有一个 高速、私有、可控 的大模型服务。结合 OpenClaw 的插件化架构,您可以在任何对话中随时调用本地模型,并使用 WordPress‑Publishing‑Skill 将使用手册、教程或自动生成的报告直接推送到站点,实现 从模型部署 → 对话交互 → 内容发布 的完整闭环。

祝您玩得开心,模型部署顺利!如果还有其他需求(例如 Docker 镜像化、GPU 监控脚本),随时告诉我。🐉🌸

暂无评论内容