大家都知道openclaw使用token是哗哗的流啊,几千万的token都写不了几篇文章,那么怎么才能免费的使用大模型的token呢?

这里给大家介绍一下OpenRouter:

OpenRouter 是一个面向开发者的大语言模型(LLM)API 聚合网关平台。简单来说,它为你提供了一站式的模型调用服务。

为什么需要 OpenRouter?

如今AI领域模型种类繁多,各家的API接口、计费方式和认证体系互不兼容。OpenRouter正是为了解决这个问题而生的“中间层”:

统一接口:一个API、一把API密钥,集成超过450种主流模型。

简化开发:接入一个OpenRouter,就等于接入了所有主流模型库,大幅节省开发时间和维护成本。

打破地域限制:帮助无法直接访问特定模型的开发者或地区用户,通过统一代理调用所需API。

核心功能与工作原理

OpenRouter作为AI界的“万用遥控器”,其核心优势体现在:

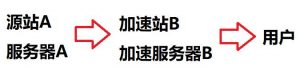

统一API网关:OpenRouter将不同厂商的接口统一封装为兼容OpenAI API的格式,便于直接复用现有代码。

智能路由与容灾:OpenRouter会根据预设的策略(如成本优先、速度优先)将请求智能路由到最优的模型提供商。当一个模型不可用时,它还能自动进行故障转移,保证应用的高可用性。

支持“自带密钥”(BYOK):你可以选择绑定自己已有的模型API密钥,平台仅作为流量通道,收取一定比例的费用。

性能与可观测性:OpenRouter通过全球边缘网络运行,增加的延迟通常仅有15-25毫秒。同时,平台提供统一的分析面板和排行榜,方便你监控调用成本、延迟和模型性能。

商业模式与定价

OpenRouter的商业模式清晰透明,主要有以下特点:

灵活的定价模式:平台提供“按量付费”和“自带密钥”(BYOK)两种模式。

免费模型支持:平台提供部分免费的开源模型(如 Llama 3, Gemma),供开发者测试使用。

透明的平台费用:对于商业付费模型,价格通常与模型官方保持一致。若使用平台提供的密钥,账单中会包含一个5%-10% 的平台附加费。

统一账单管理:一个账户、一个账单,简化财务管理流程。

优缺点分析

了解核心功能后,我们来看看它的具体优缺点。

✅ 优点

极大简化集成:单一接口接入海量模型,显著降低开发和维护成本。

灵活的实验环境:可以轻松切换和对比不同模型,快速找到最适合业务场景的模型。

应用更健壮:内置的智能路由和故障转移机制,避免了单点故障风险,提升应用稳定性。

友好的免费层:提供免费模型,方便开发者进行概念验证或构建个人项目。

❌ 缺点

额外的延迟开销:所有请求都需经过中间层,通常会引入15-40毫秒的额外延迟。

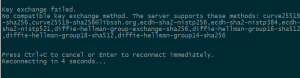

潜在的网络问题:对于国内开发者,连接海外服务器可能面临网络延迟或不稳定的情况,需要配合代理或国内网关使用。

数据隐私考量:所有请求都经由第三方平台,如果处理敏感数据,需要评估数据隐私风险。

对特定功能的支持:某些模型非常独特的参数或功能,在统一接口下可能无法支持。

快速上手

注册与获取密钥:访问 OpenRouter官网:https://openrouter.ai/,使用邮箱或GitHub等账户注册。在控制台的 “Keys” 页面创建一个新的API密钥。

选择模型与调用:使用任何支持HTTP请求的工具或编程语言,将请求发送到 https://openrouter.ai/api/v1/chat/completions,并在请求头中带上你的API密钥。

OpenClaw使用OpenRouter步骤

注册 OpenRouter 并获取 API Key

访问 OpenRouter 官网,点击 “Sign Up” 注册账号。

登录后,进入控制台,点击 “API Keys” → “Create Key”,生成一个以 sk-or-v1- 开头的 API Key。

保存好这个 Key(复制到剪贴板)。

API Keys | Settings | OpenRouter

在 OpenClaw 中添加 OpenRouter 提供商

这一步我们通过命令完成,就像向导在问你问题一样。

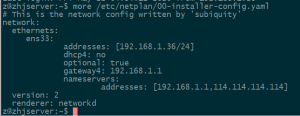

在 Ubuntu 终端中,执行以下命令,启动 OpenClaw 的配置向导(它会引导你添加模型提供商):

openclaw configure --section models向导会问你:

“添加新的模型提供商?” → 输入 y 并回车。

“提供商名称?” → 输入 openrouter 并回车。

“API 基础 URL?” → 输入 https://openrouter.ai/api/v1 并回车。

“API Key?” → 粘贴你刚才复制的 API Key 并回车。

“API 类型?” → 输入 openai-completions 并回车。

“是否添加模型?” → 输入 y 并回车。

接下来,向导会依次让你添加几个免费模型。请按下面的信息输入:

每添加一个模型,向导会依次询问这些字段。如果不想添加这么多,至少添加 2-3 个。

添加完所有模型后,选择 “结束添加” 并保存配置。

设置模型回退链(fallbacks)

现在我们要把刚刚添加的模型配置成一个轮询队列。继续跟着向导走:

执行以下命令,编辑默认 Agent 的模型配置:

openclaw config edit agents.defaults.model你会看到当前的主模型(可能是 openrouter/qwen/qwen3.6-plus-preview:free)。我们需要把它改成支持回退的形式。

请将内容修改为如下格式(你可以直接复制,替换掉原来的内容):

{

"primary": "openrouter/qwen/qwen3.6-plus-preview:free",

"fallbacks": [

"openrouter/google/gemini-2.5-flash:free",

"openrouter/deepseek/deepseek-chat:free"

]

}解释:当 primary 模型失败(如速率限制、超时等),OpenClaw 会依次尝试 fallbacks 列表中的模型。

保存文件并退出编辑器(Ctrl+O,回车,Ctrl+X)。

重启网关并测试

重启 OpenClaw 网关:

openclaw gateway restart现在,在飞书或 QQ 里向你的机器人发一条消息。如果 primary 模型工作正常,它会用 Qwen 回答。如果 Qwen 的免费额度用完或出现错误,它会自动切换到 Gemini,再不行就换 DeepSeek。

想验证回退是否生效,可以故意触发速率限制(例如短时间内连续发多条消息),观察日志中是否有模型切换的记录:

openclaw logs --follow你会看到类似 fallback to openrouter/google/gemini-2.5-flash:free 的提示。

![苹果cms使用火车头发布数据报错:“SQLSTATE[22001]:String data,right truncated:1406 Data too long for column ‘vod_blurb’ at row 1”-下雪啦资源网](https://www.xiaxuela.com/wp-content/uploads/2020/12/da6b8ce280dece1-300x95.png)

暂无评论内容